@荞麦 chen:如果你觉得自己不配,那就一定要上。

不管是恋爱还是工作。

要选择 “感觉自己不配的东西”。

@李银河:爱情这个东西很奇妙,它的理想形态应当是肉体朋友和精神朋友合二为一的一个实体。这两种性质能恰好凑到一个人身上的概率真是太小了,可遇而不可求。我相信,很多剩男剩女就是在等待这个人,等待自己生命中这个可遇而不可求的奇迹。

@有限次重复博弈:对于绝大部分中国人来说,躺平只是一种奢望,轻松闲适的生活方式跟他们绝缘

@理白君: 躺平本身也是要有资本的,这个资本有些是你上一代给你的,有些是你前半生的积蓄给你的,但有一点肯定不是天上掉下来的。

@水獭 otter:看见邻居大哥在楼道里玩泥巴,好奇的问了一下在干吗。邻居大哥气急败坏的说:帮小孩做手工作业。

@涉过卢比孔河:暴风雪山庄这个模式太有安全感了,与外界隔绝不用回任何工作信息,外面大雪纷飞,大家在同一座华丽山庄吃好喝好地度假,醒了还能看侦探推理,只要死个人就行,死的不是本人固然好,那享福了,死的是本人也没关系,那享福了,能活着出去明年度假还来暴风雪山庄。

@阿甜不太甜阿:蝉真的是世界上最摇滚的生物了。一生大部分时间都在地下,醒来爬到地上就开始对这个世界狂叫,只是为了交配,交配完就立马挂掉。

盛夏,音乐,性,死亡。这太摇滚了。

我们关心油米酱醋更多,我们是幸福的文盲

@阿尔法虎虎:差不多八年前,我的一个前同事去伊朗旅行,回来还送了我几包藏红花茶,很精致。

我很惊异地问他:那不是经常打仗的地方么,你怎么去那里玩儿?

他告诉我,中东虽然不太平,但是伊朗很安全,我印象中经常打仗的应该是伊拉克,而不是伊朗。

我看到他发的朋友圈,很多历史文化古迹,他对这些感兴趣、有研究,游得津津有味。

我心想,我可真是个文盲啊。

三年前,我去阿联酋游玩。我妈说,那是哪里。我说在中东。我妈说,那不是很乱的地方么,打仗的地方你也去?

我笑她是个文盲,我说那可是迪拜啊,黄金铺成的宫殿,世界上的有钱人都喜欢去那里。虽然我不是有钱人,可是去了没准能沾点财运。

我现在回头想想,我们没有很关心世界大事的细节,正是因为生活在安全感十足的国家里。我们关心油米酱醋更多,我们是幸福的文盲。

直到 2010 年 10 月 3 日,德国才彻底还清了第一次世界大战的战争赔款《凡尔赛赔款》

@少年伯爵:今天聊一个德国的冷知识 —— 直到 2010 年 10 月 3 日,德国才彻底还清了第一次世界大战的战争赔款《凡尔赛赔款》。

为何如此久?居然用了 91 年来偿还战争赔款?

因为《凡尔赛赔款》堪比人类历史上最狠的战争赔款,第一次世界大战后,《凡尔赛合约》规定,德国需要赔偿协约国 1320 亿金马克,在当时相当于 47256 吨黄金

看到近 5 万吨黄金的赔款,晚清李鸿章突然觉得自己又行了 —— 因为就晚清被洋鬼子折腾 60 年,不平等条约签了一大堆,总共加起来是 1368 吨黄金的赔款。

还没有《凡尔赛赔款》的 34 分之一零头多。

而最终实际赔款的情况,则是德国人赔了 7180 吨黄金,晚清赔了 735 吨黄金。

德国被吸血太狠了,50 万马克的面包价格都已经算是很眉清目秀了。

德国人心想,既然不给我们活路,那就拉所有人一起面对地狱吧。

于是二战开打了。

二战打完之后,洗头佬曾经疯批的样子,让西方各国都吓尿了,可不敢再把德国逼急了,所以后来减免 / 暂停了《凡尔赛赔款》,还帮西德搞重建……

正所谓双赢的基础,其实是具有拉别人一起双输的能力。

这个能力也叫桶盏价值。

韩国国税厅的草台班子事件

@Steed 的围脖:3 月 2 日凌晨,有人注意到韩国国税厅官网上的一篇新闻稿有点不对劲。

这篇稿子是几个小时前刚发的,内容是国税厅的一次 “战果展示”。他们从 124 名偷税漏税的富人手中,一共查扣了价值 560 万美元的加密货币。稿子配了几张照片,其中一张拍到了一台 Ledger 硬件钱包,旁边放着一张手写的纸条。

纸条上,清清楚楚写着一串英文单词。

懂行的人一眼就看出来了:这是助记词。

所谓助记词,可以理解为加密货币钱包的终极密码。它通常由 12 个或 24 个看似随机的英文单词组成,按顺序排列。谁掌握了这串词,谁就能在任何地方、任何设备上打开这个钱包,把里面的钱全部转走,不需要 PIN 码,不需要指纹,不需要任何额外的验证。

换句话说,韩国国税厅刚刚把保险柜的钥匙,公开挂到了自家官网上。

接下来的事情,完全在意料之中。

区块链分析专家赵在宇(Cho Jae-woo)后来告诉韩国媒体,有人迅速行动了。链上数据显示,这个人先往钱包里充了一小笔以太坊作为手续费,然后分三次,把钱包里的 400 万枚 PRTG 代币全部转走。这批代币当时价值大约 480 万美元。

等国税厅反应过来撤下新闻稿的时候,稿子早已被各家媒体和科技网站截图保存,钱包也已经被清空。

周日,国税厅发了第二篇新闻稿,对这次泄露 “深表歉意”。他们解释说,当初放那张照片,只是为了让稿子 “更加醒目”。

赵在宇对此的评价是:把助记词拍进照片发到网上,就相当于把钱包敞开放在大街上。而且讽刺的是,这个钱包的原主人其实做了正确的事 —— 只用手写方式记录助记词,从不把它存到任何联网设备上。这恰恰是加密货币安全领域最推荐的做法。结果警方一拍一发,所有的安全措施全白费了。

目前国税厅已经联合国家警察展开追查,试图追踪资金流向。但现实很骨感:由于新闻稿传播范围极广,嫌疑人可以是任何人。唯一的突破口可能在于,如果窃取者试图通过正规交易所把代币换成现金,就有可能暴露身份。不过分析人士指出,在当前市场条件下,一次性变现这么大一笔加密货币本身就很困难。这意味着,这个意外获得一笔巨款的人,大概率会选择趴着不动,等待时机。

这不是韩国警方第一次在加密货币保管上翻车。

今年 1 月,光州的执法部门就曾发现一批查扣的比特币不翼而飞,怀疑与一起针对 Coinbase 的钓鱼攻击有关。上个月,首尔江南区警方又不得不启动内部调查:22 枚查扣的比特币凭空消失,冷钱包被清空,但硬件设备始终没有离开过警方的控制。这意味着,有人可能在内部就接触到了敏感信息。

三起事件,三种丢法,指向同一个问题:韩国执法机构在加密货币的保管和处置上,还远远没有建立起与传统物证管理同等水平的安全体系。

传统世界里,查扣一箱现金,锁进证物室就行了。但加密货币不一样,它没有实体,一串密码就是全部。保管它需要的不是更厚的铁门,是对数字安全的深刻理解。显然,至少在韩国,警方还在用管理纸钞的思维来管理数字资产。

而这一次,代价是数十亿韩元,以及公众信任的又一次损耗。

老大哥开始看美国人民了

昨天乃悟在朋友圈看到一篇文章吹捧 Claude 和 Palantir 是怎么帮助美以干掉哈梅内伊的,大家都在转。这文章写得是不是真的,是不是 AI 写的先放一边,咱们来看看它俩之前干过啥。

按照美国媒体的报道,在绑走马杜罗的行动中,也有 Claude 参与。美国战争部之所以选 Claude,按官方说法是 Claude 最先进也最安全。

从 2003 年起,彼得・蒂尔的 Palantir 就拿了 CIA 的风投,一直服务于美国情报机构和军方,做数据处理和决策。

作为 AIP 也就是 AI 集成平台,Palantir 集成了 Claude。简单点说,战争部的数据是水池,Palantir 是管道,而 Claude 就是处理水的工厂,水处理效果让战争部的朋友很满意。

组织上一满意,就决定给它俩加加担子。

绑走马杜罗仅仅 6 天后的 1 月 9 日,战争部长海格塞斯发布了一份备忘录,要求 AI 公司:

取消对 AI 的技术限制。

这引起了 Claude 母公司 Anthropic 的警惕,他们坚决要求在合同里写明两点,一是 AI 不能用来大规模监控公民。第二是 AI 不能完全自主操作武器。前者侵犯公民自由,后者是因为 AI 经常出现误判。

堂堂兵部尚书,让你改你还敢不改?Claude 还真敢。

海尚书解释过,他说我们不会侵犯公民隐私,也不会让 AI 操控武器,但写进合同我看就没有这个必要了吧?

海尚书也愤怒过,他说国家安全不能被一群私营企业绑架,军事决策不能被资本家干预。他们指责 Claude 的母公司 Anthropic 是在扮演上帝,属于白左,强烈要求 Anthropic 开放权限,让战争部利用 Claude 进行一切:

合法行动。

海尚书甚至还搬出金毛懂王,他亲自下场发帖警告 Anthropic。领导们威胁说,如果不听话,就把你们踢出供应链,而且要求所有和美国政府以及战争部做生意的供应商都不准使用 Claude。

您猜怎么着?Anthropic 竟然一点也不怂,他们说凭我们的良知无法答应这样的合同。还对海尚书和金毛懂王的威胁冷嘲热讽,说别人想用 Claude 就可以用,你管算老几?!

此时此刻,恰如 1566 彼时彼刻啊。

有一说一,Anthropic 没有被查税,没有被反垄断,说明海尚书和金毛懂王还是有点雅量的。

再说两句昨天刷屏的文章。现在的大模型都是根据概率进行生成。其优势在于反应迅速,缺点则在于缺乏逻辑。

像哈梅内伊最可能先迈哪条腿这种问题,AI 是推理不出来的,或者说其效果远逊于人类。

按照 Anthropic 自己的说法,Claude 在战争部主要承担的任务类似于文秘,比如快速情报分析,模拟、输出作战规划等等,都不涉及军事核心决策。

但 AI 对输入、抓取、快速生成这一套非常熟悉,效率远高于人类分析师。

善用这种效率,可以高效监视人类。把一个人的社交网络信息和网络痕迹喂给 AI,让 AI 找出规律,总结特征,从里面挑出比较危险的交给人类管理员关注是 AI 可以做的。

乃悟觉得 Claude 决不妥协是有意义的,毕竟这一套 AI 组合拳在另一个国家那是打得贼溜。

最新的消息是,战争部非常干脆利落地撇开了 Anthropic,转头用上了 OpenAI。有意思的是,OpenAI 的 CEO 表示他们也立下了红线,甚至比 Anthropic 还多了一条。

让我们来猜一下,为啥这次战争部就接受了呢?

来源:星球商业评论

苹果不但要把 Siri 的 AI 能力全都交给谷歌,连整个云服务也都要全盘由谷歌云托管

@阑夕:根据 The Information 的深度报道,苹果不但要把 Siri 的 AI 能力全都交给谷歌,连整个云服务也都要全盘由谷歌云托管,是对这波 AI 引发的算力浪潮一点准备都没有:

– 多年以来,苹果的管理层都遵循财务指导,将云计算视为成本中心而非创收业务,不愿意像亚马逊、谷歌、微软那样自建数据中心,所以也从来没有储备云计算方面的技术专家;

– 最初推出 iCould 照片备份服务时,苹果就用 AWS 来解决需求,相当于用户付钱给苹果买储存空间,而苹果再付钱给 AWS 来租服务器,因为 iCould 的规模涨得太快,苹果逐渐觉得 AWS 不划算,这才开始自建私有云;

– 但苹果内部只把云计算当成不得已而为之的必要投入,并没有给它足够的战略重视,所以在管理上非常草率,比如当 iTunes 的服务器有空闲时,其他团队是没办法使用的,最后统计下来,苹果的私有云平均使用率只有 10%,大量的服务器闲置在机房吃灰;

– 当 AI 爆发之后,苹果发现即便重新捡回私有云的算力资源也不太行了,因为那些英伟达芯片全都是老旧版本,故障率也很高,于是没办法,苹果又开始找 AWS 来解决 AI 相关的计算需求,同时继续视谷歌为主营业务方面的竞争对手;

– 但谷歌的大模型和 TPU 芯片还是太香了,在谷歌的推动下,苹果接受了一个全家桶方案 —— 没错,苹果从全家桶的卖方变成了买方 —— 把 Siri 搭载的模型、服务器、芯片通通包给谷歌,今年推出的全新 Siri 会是决定 iPhone 18 新机价值的大招。

三年前 OpenAI 预测不会被 AI 影响的职业,正以 4 倍速被残酷碾压

2 月 27 日,美国金融科技公司 Block 宣布裁员 40%,约 4000 人,以全面转型为 AI 公司。AI 概念戏剧性地导致其股价暴涨超 20%。这家在硅谷算不上举足轻重的公司的案例,却透露出 AI 快速发展可能引发的经济连锁反应。

在这背后,有一个数字,在过去三年被改写了四次。

2023 年 3 月,OpenAI 说:美国约 19% 的工人会看到超过 50% 的工作任务被 AI 影响,这个过程需要十年。

2026 年 1 月,Cognizant 说:这个比例已经是 30%,而现在距离 ChatGPT 发布才三年。

同一个月,斯坦福数字经济实验室在分析了 2.85 亿条招聘广告后发现:AI 高暴露度行业的入门级岗位招聘量下降了 18%-40%,而资深员工的需求在上升。

如果你还在用”AI 会不会抢走人类工作” 这个二元问题来理解这场变革,你已经落后了。真正在发生的不是岗位的消失,而是劳动力市场结构的熔断:入口在关闭,中间层在塌陷,而站在塔尖的极少数”AI 驾驭者” 正在收割一切。

更可怕的是,根据 Citrini Research 对 2028 年的推演,这场撕裂才刚刚开始。

2023 年的刻舟求剑与 2026 年的凛冬骤至

把时钟拨回 2023 年 3 月,ChatGPT 刚刚引爆全球。OpenAI 的研究人员联合多所大学发表了一篇里程碑式的论文、《GPTs are GPTs》(生成式预训练模型是通用目的技术)。

当时,OpenAI 的团队采用了一套基于任务暴露度(Exposure)的评分模型。他们得出的结论是:美国约 80% 的劳动力至少有 10% 的工作任务会受到 GPT 的影响,而约 19% 的打工人会看到超过 50% 的任务被波及。

更有意思的是,他们发现了一个「高薪悖论」,与过去几十年自动化技术(如机械臂)总是最先淘汰蓝领工人不同,GPT 时代,薪酬越高的认知型工作,暴露度反而越高。 在技能树上,编程和写作技能与 AI 暴露度呈强正相关,而科学和批判性思维则被认为是「安全区」。

在那个时间节点,研究人员明确标注了一个局限性:他们没有将视觉等多模态能力计算在内。他们那时候甚至都没考虑到工具使用能力。

在 2023 年的框架里,AI 仍然是一个被困在屏幕里、只懂处理文本和代码的缸中之脑。他们给出的上限预测是,这场重构可能需要长达十年的时间(到 2032 年)才会彻底展开。

时间来到 2026 年初,全球 IT 服务巨头 Cognizant 发布了他们对 2023 年研究的更新报告《新工作,新世界 2026》。

报告的开篇就表明「我们原本预测需要十年(到 2032 年)才会发生的事情,现在已经提前六年就在我们眼前上演了。」

数据显示,今天美国已有 93% 的工作受到 AI 不同程度的影响。

Cognizant 用了一个指标叫「速率得分」(Velocity Score),说白了就是你的职业被 AI 吃掉的速度有多快。

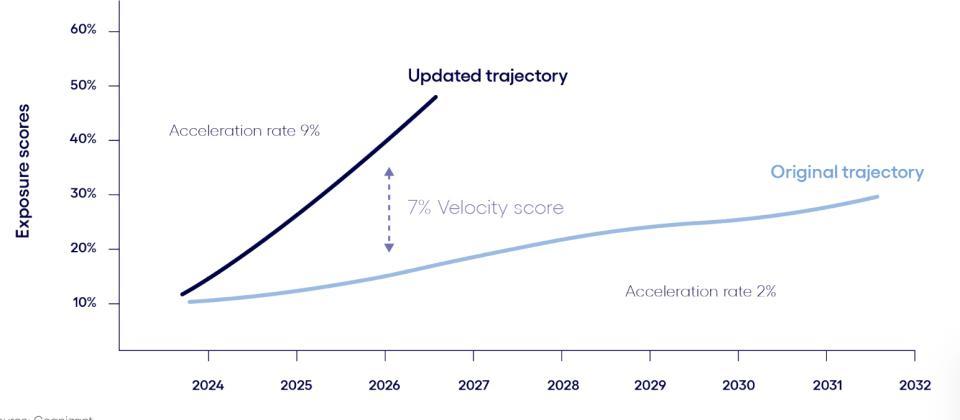

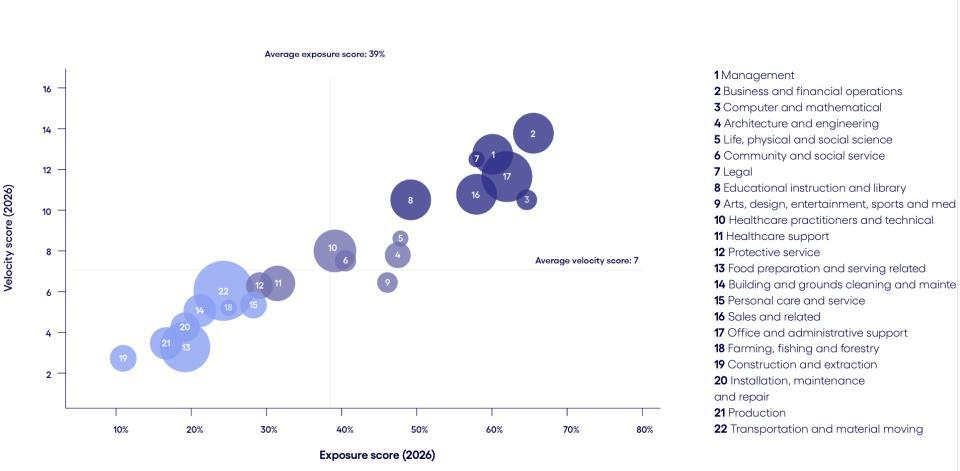

如下图所示,此前所有职业的 AI 暴露度年均增长 2%,现在已经跃升到 9%,相当于加速了 4.5 倍。这意味着,那些在 2023 年看起来属于「AI 动不了我」的职业,现在正以 4 倍速度被卷进来。

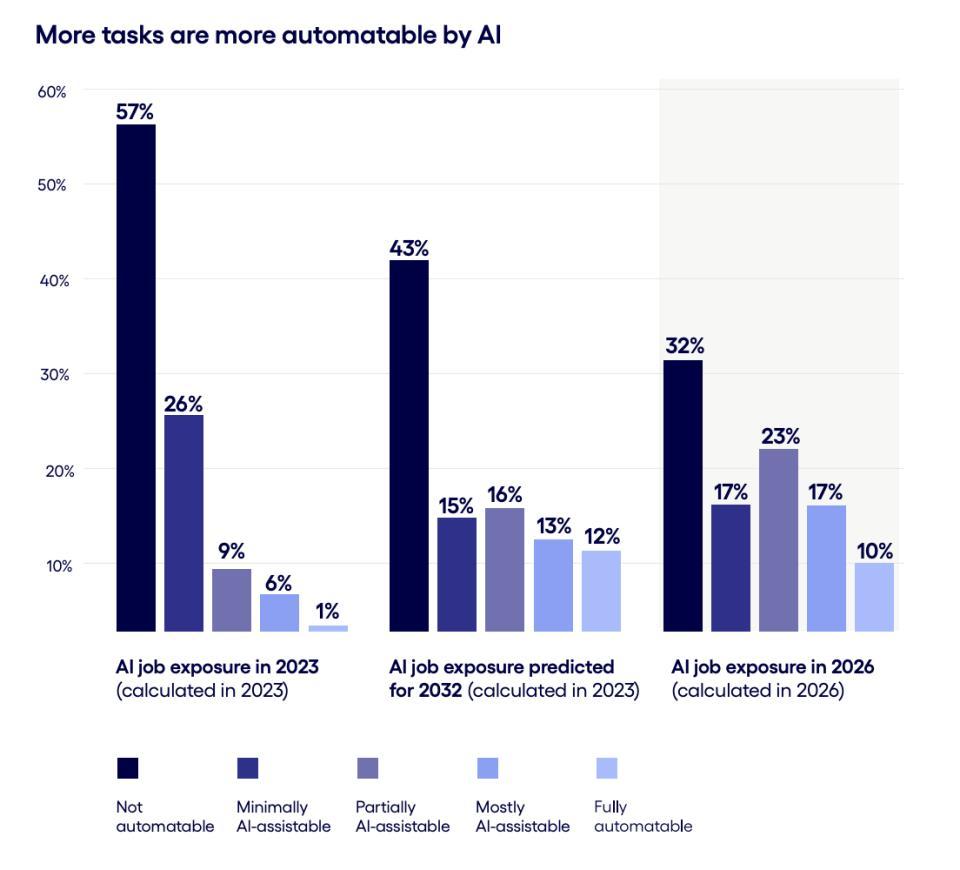

具体到岗位上,任务暴露度超过 50% 的岗位比例从 2023 年的 0% 飙升至 30%(原预测 2032 年仅为 15%),而所有任务至少暴露 25% 的岗位则增长了 17%,达到 69%。

Cognizant 测算,仅在美国,这相当于将价值 4.5 万亿美元的人力劳动成本转移给了 AI,约占美国 GDP 的 15%。

这种加速是从哪儿来的呢?

报告用了一个很细的分类,描绘了不同暴露度的分层。

E0 (No exposure) – 完全不暴露,32% 的任务

E1 (Direct exposure) – 直接用 GPT 就能省一半时间,10% 的任务

E2 (LLM+ tools) – 需要配套软件但可行,17% 的任务

E3 (With image capability) – 加上视觉能力后可行,17% 的任务

Full automation – 完全可自动化,10% 的任务(这是 2023→2026 最大的跃升,从 1% 到 10%)

从这个分类我们就可以看到,从 E1 到 E3,也就是 LLM 加上多模态(眼睛与耳朵)和高级推理(大脑)以及随之而来的 Agentic AI 智能体(手与脚)带来的改变最大。单纯的 ChatGPT 其实影响有限(10%),但一旦 Agent 能使用专业工具,影响就扩大到 27%,再加上视觉处理的范畴,则直接覆盖到了 44% 的工作。

比如一个修水管的工人,AI 单独看或想都替代不了他,但当 AI 能「看懂漏水的位置 + 推理出可能的原因 + 生成维修方案 + 自动下单配件」,那他的工作就被重构了。虽然还得他去拧螺丝,但前期诊断和后续报告都不需要他了。

这种复合能力的爆发,导致了几个在 2023 年无法想象的后果。

第一,管理层不再安全。 曾几何时,CEO 和高管们认为协调、预算分配和决策是人类独有的。但在 2026 年,Agent 能够自主安排日程、根据支出模式重新分配预算、追踪项目进度。Cognizant 的数据显示,CEO 的 AI 暴露度从 25% 飙升至超过 60%。

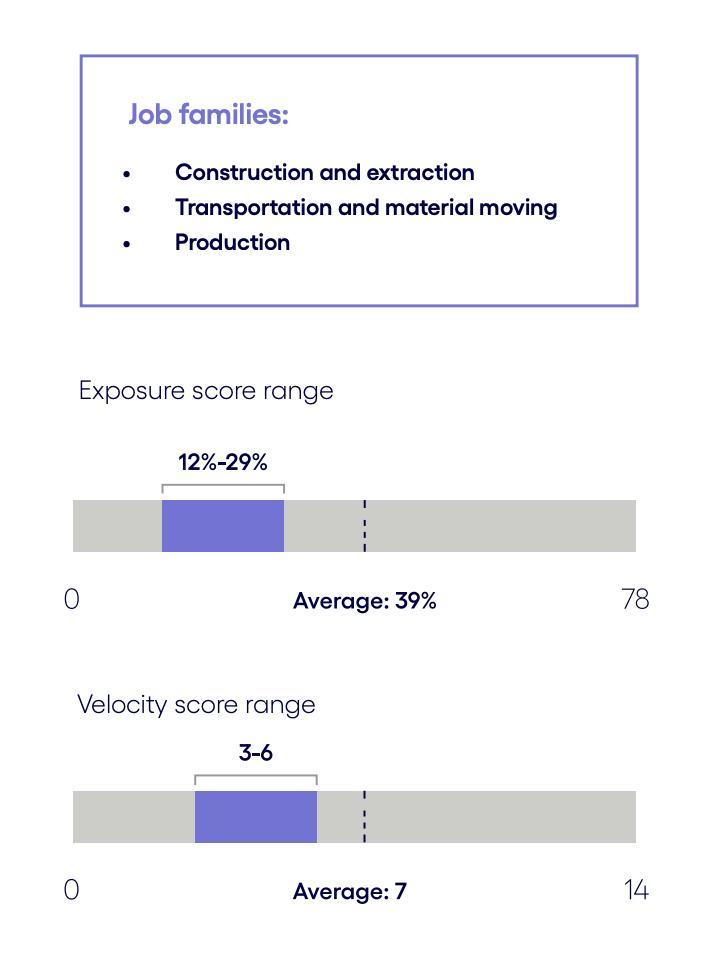

第二,蓝领与物理世界的防线被渗透。 建筑工人、机械师和水管工曾被认为是 AI 无法触及的低风险区。但在多模态和 AR 穿戴设备的加持下,AI 现在能够分析现场照片以诊断管道泄漏,或者读取建筑蓝图。建筑业的 AI 暴露度从 4% 上升到了 12%,交通运输业从 6% 暴涨至 25%。 一个水管工不会失业,但他未来的工作方式是被 AI 头显直接指挥的。

按可由 AI 完成的任务百分比排名,Cognizant 选出了受 AI 影响最大的六个职业。

排在榜首的是财务经理,84% 的工作内容可以被 AI 接手。换句话说,财务规划、预算分析、风险评估这些核心任务,AI 都能插上一手。

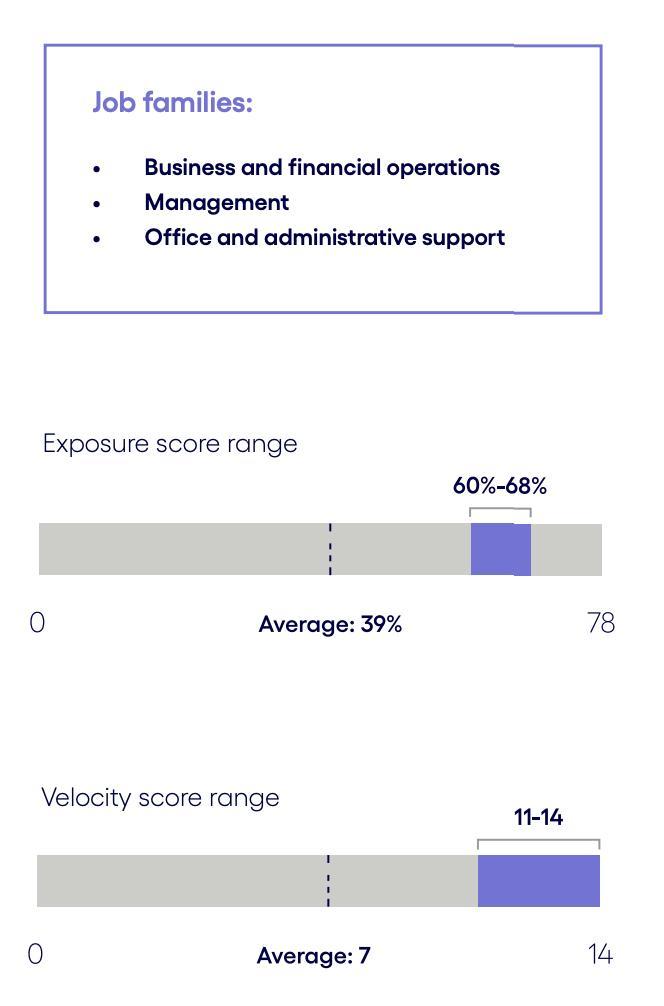

计算机和数学相关职位紧随其后,受影响程度达到 67%。商业和财务运营、办公室和行政支持这两个大类都在 60% 到 68% 之间。法律职业 63%,管理工作(包括高管层)60%。

过去几个月,软件开发领域的变化尤其明显。Anthropic 的首席工程师鲍里斯・切尔尼(Boris Cherny)今年 1 月透露了一个令人惊讶的数字:他们公司几乎 100% 的代码,都是由自家 AI 产品 Claude Code 和 Opus 4.5 编写的。

「就我个人而言,我已经有两个多月没亲手写过代码了,连小修改都不做。」切尔尼说,「昨天我提交了 22 个拉取请求,前天提交了 27 个,每一个都是 Claude 写的。」

当然,他们发现 34 个职业完全没有任何任务暴露。这些职业清一色是纯体力、现场、手工活:砌砖工、屠宰工、洗碗工、石匠、轮胎修理工…

这些变化,可能意味着劳动力市场的极化会加剧。

高技能的人用 AI 变得更高产,低技能的人困在无法自动化的低薪苦活里,中间那批能自动化但还没完全自动化的中等技能白领工作最危险。

而这正是在当下招聘市场中真实发生的事。

大数据不会撒谎:入口已经关闭,中间层正在塌陷

预测看起来很紧迫,但在过去现实中的劳动力市场到底发生了什么?

当我们把目光转向由 Lightcast、PwC、Indeed、Stanford 等机构汇编的过去三年(2023 年 – 2026 年)的在线招聘广告大数据时,会发现很多符合预言的部分。

报告当时预测,高工资职业普遍展现出更高的暴露度,并且暴露度与职业所需的编程和写作技能正相关,与科学和批判性思维技能负相关。这些在招聘广告数据里都得到了验证。

而且方向也大体正确,即越是知识密集、文本密集、规则密集的工作,AI 渗透越快;越是需要物理操作、现场判断、人际互动的工作,暴露度越低。

被超越的部分是速度。2023 年的报告预测这些变化会在十年内展开,结果三年就看到了显著的结构性变化。更重要的是,报告当时强调我们的暴露度测量不区分劳动增强和劳动替代,言下之意是技术可行不等于实际采用。但现实是,企业的采用速度比学术界预期的快得多。

深入去看,我们会看到一幅被研究者命名为「混合转型」(Hybrid Transformation)的图景。这个温和的学术术语掩盖不了它的本质,即一场正在发生的阶级重组。

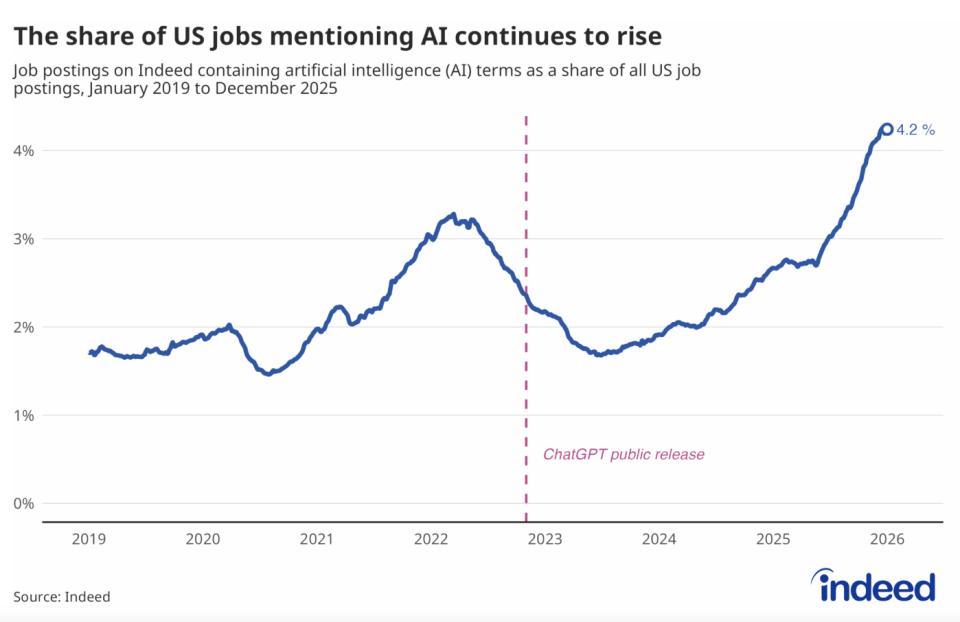

首先,在这个转型中,得利最多的是 AI 使用者。截至 2025 年底至 2026 年初,纯粹的「AI 技能岗位」在整体招聘市场中占比依然不高,大约在 4.2% 左右。 但它的增速是极其恐怖的,生成式 AI 相关岗位的提及率相比 2023 年增长了 3 倍以上。

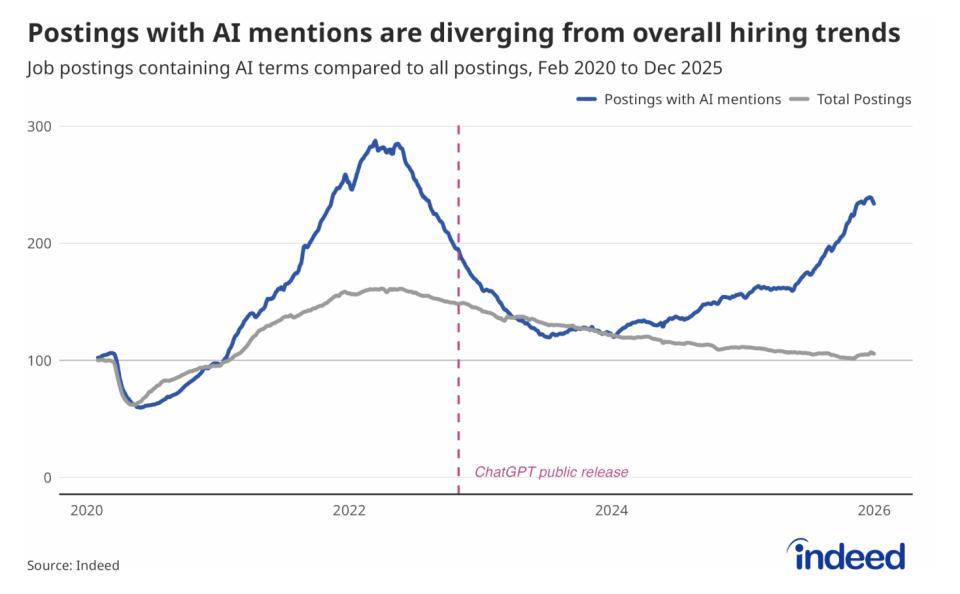

而且,从 2023 年低期,招聘开始分化,所有招聘在减少的情况下,提到 AI 的招聘却在一路上行。

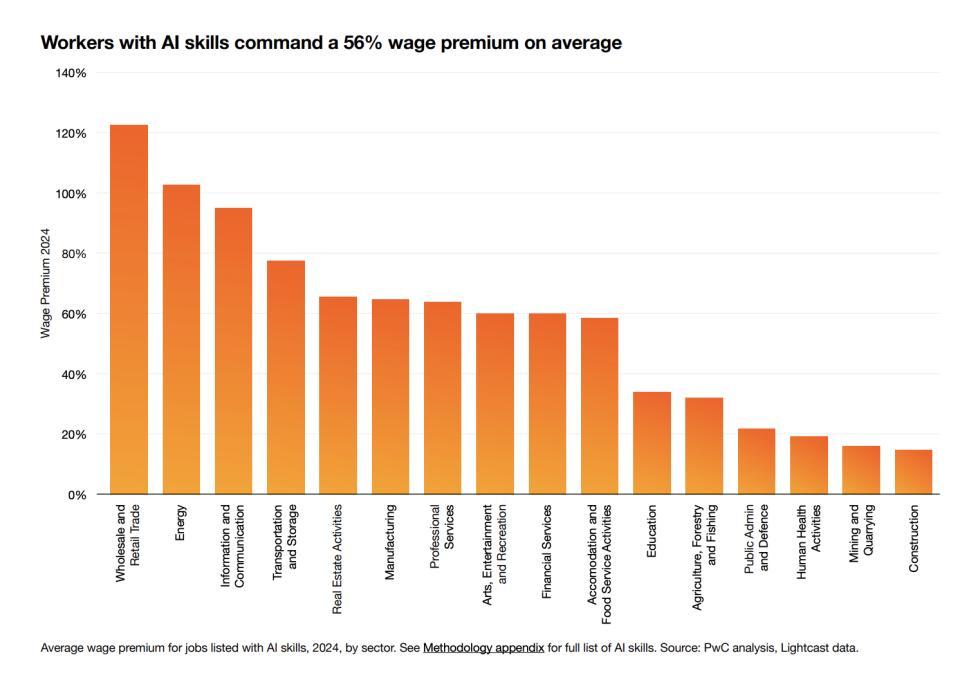

市场对这极小部分掌握新生产力工具的人给予了极其丰厚的回报。PwC 和 Lightcast 的数据高度一致:在同一职业中,包含 AI 技能要求的岗位平均能获得 15% 到 30% 的薪资溢价,甚至在某些核心知识领域(如律师、金融分析师)工资差异能拉大到 56%。

这绝不是全体打工人的「共同富裕」,而是工资结构的剧烈分化。企业愿意为能用 AI 十倍速提升产出的人付高薪,同时开始冻结那些只做传统重复性脑力劳动的人的薪水。

其次,是在这三年间,入门级白领岗位的「隐性死亡」。AI 并没有在宏观层面造成总就业人口的断崖式崩塌(目前招聘总数仍在疫情后常态波动),但在「新手村」,一场屠杀已经发生。

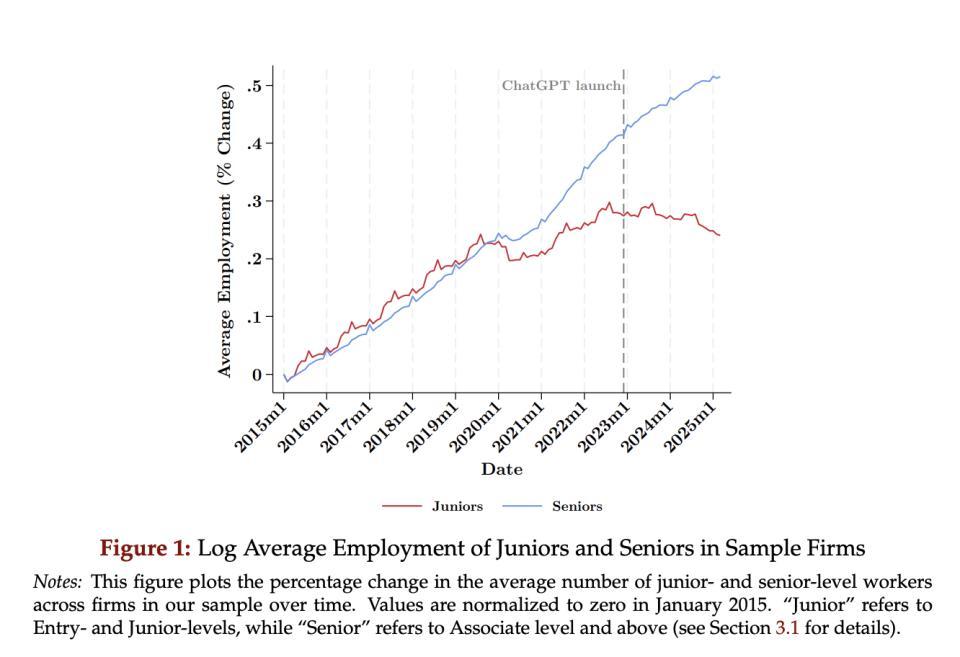

斯坦福数字经济实验室结合 ADP 薪酬数据与数千万份简历的分析表明,自 2022 年末 ChatGPT 爆发以来,在 AI 高暴露度行业中,22-25 岁年轻人群的就业出现了显著的收缩(下降约 6%,软件开发等领域甚至回落 20%),而同行业的年长资深员工就业依然在增长。

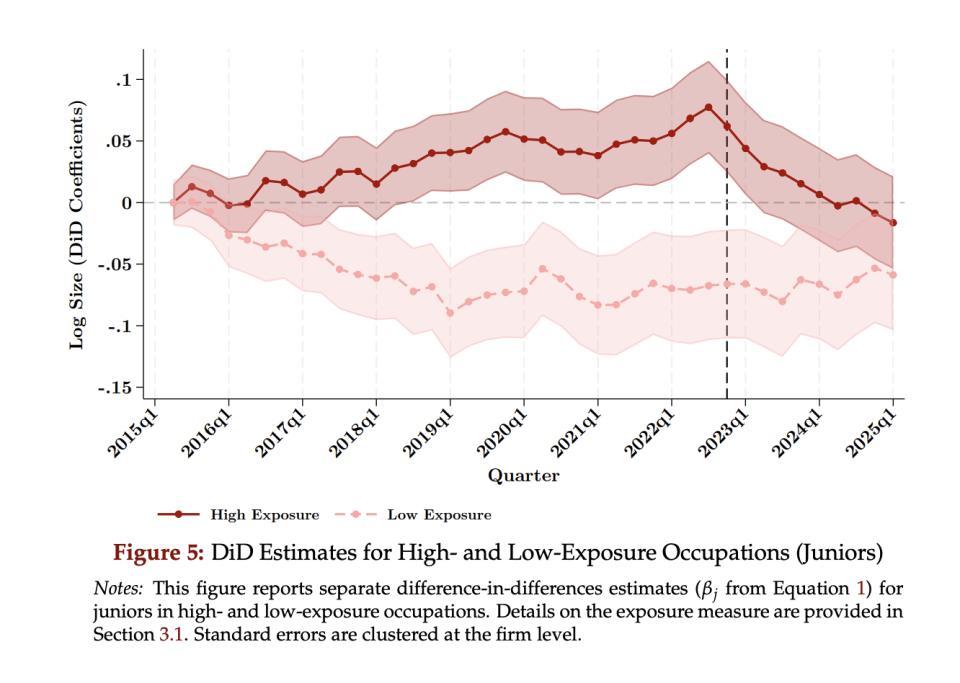

一篇基于 2.85 亿条美国岗位广告的因果识别研究估算,ChatGPT 发布后,高 AI 可替代性职业的岗位广告数量相对低可替代性职业平均下降了约 12%。而且这个效应对无需高学历 / 无需更多经验的入门岗位更强,分别达到 18% 和 20% 的降幅。行政支持类职位的降幅甚至接近 40%。

这被称为「偏向资历的技术变革」(Seniority-Biased Technological Change)。 过去,大公司需要招聘大量的应届生和初级员工来做基础的代码审查、数据清洗、草拟财报、整理法律文档。现在,资深员工借助几个 AI Agent 就能搞定这些脏活累活。

一项覆盖 6200 万劳动者的研究发现,从 2023 年一季度起,采用 GenAI 的企业初级岗位就业明显下滑。企业不是在裁人,而是干脆不招了。

因为中级员工用上 AI 之后,能干更多活。企业甚至懒得开掉初级员工,因为不招新人,让老人自然流失就够了。这种温水煮青蛙式的裁员,连劳动法都管不着。

年轻人进入职业阶梯的「第一级台阶」被 AI 抽走了。

最后一个趋势是,任务重写(Task Rewriting)取代职业消亡。2013 年牛津大学曾有过一个著名的恐怖预测,认为未来「47% 的岗位会被自动化」。它为什么至今没有发生?因为职业是一个壳,里面包裹着无数个「任务」(Tasks)。

Indeed 和 Revelio Labs 的数据显示,岗位名称没有消失,但 HR 写在招聘广告里的「岗位职责(JD)」被重写了。 在财务、文书、初级代码岗位中,「日常对账」、「生成标准代码」等容易被 AI 取代的任务占比正在直线下降;取而代之的是,企业要求应聘者具备「复杂性管理」、「AI 系统引导」、「边缘案例解决」和「质量验证与判断」的能力。

这印证了 Cognizant 的洞察。即使一个职位有 39% 的任务被 AI 接管,剩下的 61% 也需要人类把 AI 干完的活整合起来,放入更大的商业语境中。 未来一两年内的时代是「人类 + AI」的重构,纯粹的执行者被淘汰,留下的是审判者和协调者。

但审判者和协调者也不需要那么多。

一个资深审判者 + AI 能干过去 10 个初级执行者的活,企业只需要原来 1/5 的人就够了。所谓的人机协作,本质上是用少数精英 + AI,替代掉大多数普通人。

通向 2028,Agent 奇点与全球智能危机

如果我们把当前招聘市场的「结构性挤压」和 Agent 技术的进化曲线向前延伸,会发生什么?

在回答这个问题之前,先看看过去三年发生了什么?2023 年,OpenAI 说” 需要十年”,2026 年,Cognizant 说已经发生了;2023 年,完全自动化的任务占 1%,2026 年,这个数字是 10%;2023 年,入门级岗位还在正常招聘,2026 年,AI 高暴露行业的初级岗位招聘量已经下降了 18%-40%。

如果这个加速度不变,2028 年会是什么样?

Citrini Research 在一篇名为《2028 年全球智能危机:来自未来的金融史思想实验》的深度推演中,描绘了一个令人毛骨悚然的后奇点世界。

在这个剧本中,时间线被设定在 2028 年 6 月。

在 2026 年到 2027 年间,市场沉浸在一种荒诞的狂欢中。因为 AI Agent 的大规模部署,标普 500 指数和纳斯达克一路狂飙,企业利润屡创新高。劳动生产率达到了 1950 年代以来的最高水平。创造产品的 Agent 不需要睡觉,不需要医保,也不会生病。

但经济学家们很快发现了一个致命问题,即幽灵 GDP。它指的是那些在国民账户上闪闪发光、却从未在实体经济中流转的财富。

为什么?因为北达科他州的一个 GPU 集群完成了过去曼哈顿一万个白领的工作,而机器是不会去买咖啡、交房租、看电影或者去度假的。占美国经济 70% 的消费主导型市场开始枯萎。

如果我们把当前招聘市场的「结构性挤压」和 Agent 技术的进化曲线向前延伸,这个词很可能会从隐喻变成现实。

过去的技术创新(如云计算、互联网)大多属于资本支出(CapEx),它创造了庞大的上下游就业。但 Agent 的引入是运营支出(OpEx)的直接替代。

2026 年,当 Agentic 工具(如 Claude Code 的进阶版)迎来能力阶跃时,企业 CIO 们发现,他们可以用内部的 AI 原型在几周内替代掉每年几十万美金的 SaaS 服务。软件公司(如 ServiceNow)为了保住利润,只能裁减自己 15% 的员工,并把省下来的钱投入到更强的 AI 工具中去抵御竞争。

这是一个没有任何物理制动机制的负反馈循环: AI 变强 → 企业裁员 → 用裁员省下的钱买更多 AI 算力 → AI 变得更强 → 进一步裁员。

被优化的白领们失去了收入,消费降级,导致企业收入下降,企业为了维持利润率,只能更加激进地引入 AI 并裁员。财富以前所未有的速度向掌握算力资本的极少数人集中。

2027 年,危机的烈火将从软件行业蔓延到了整个「中介层」。在过去五十年里,人类社会建立了一个极其庞大的「利用摩擦力变现」的商业帝国。因为人类没有时间、缺乏耐心、存在信息差,所以我们愿意忍受旅行平台、保险续保、房产中介的抽成。

但在 2028 年的世界里,消费者全面接入了个人 AI Agent。这些 Agent 会在后台 24 小时不知疲倦地全网比价、自动退订那些忘记取消的 SaaS 订阅、瞬间完成房产交易的尽职调查和合同审查。传统的订阅经济(赌你忘记取消)和中介经济(赌你懒得比价)在一夜之间土崩瓦解。人类所谓的「商业黏性」,在冷酷的机器最优化算力面前,被证明只不过是一层温情脉脉的「摩擦力」外衣。

「技术总会创造新工作」神话的破灭

几百年来,面对卢德分子的恐慌,经济学家总是用一句金科玉律来安慰大众:「技术在消灭旧工作的同时,总会创造更多的新工作。」ATM 机淘汰了部分柜员,但银行开出了更多网点;互联网干掉了黄页,却创造了电商和外卖。

但这一次不一样。因为过去的新工作,都必须由人类来做。 当 AI 进化为「通用智能体」(General Intelligence)时,它不仅能胜任旧工作,它在新工作上的学习速度和执行成本也远胜人类。AI 确实创造了新岗位(比如提示词工程师、AI 安全审查员),但每创造一个新岗位,就同时让几十个传统高薪白领岗位变得多余。而且,这些新岗位的生命周期极短,很快又会被下一代更强、更便宜的 Agent 自我迭代掉。

所有的线索都在指向同一个结局。AI 不会像终结者那样在物理世界上消灭人类,但它正在以一种极其高效、极致理性的方式,重构人类社会的劳动价值网络。

但这还只是问题的第一步。

到了 2028 年,真正的问题是当一个社会里,机器创造了 99% 的价值,但机器不消费、不买房、不看病、不交税,这个社会的循环怎么转起来?

我们可以嘲笑 Citrini 的 2028 剧本是危言耸听,但过去三年的数据已经证明,技术的加速度远超人类社会的适应速度。2023 年,OpenAI 说需要十年;2026 年,Cognizant 说已经发生了。那么 2028 年,会不会真的出现那个 GDP 数字狂飙、但消费枯萎的时刻?

也许答案不在技术本身,而在一个更古老的问题上,当生产力的主体不再是人类时,人类凭什么分配财富?

这个问题,亚当・斯密没回答过,马克思也没回答过。因为在他们的时代,劳动永远是人类的。

Block 裁掉的那 4000 人,华尔街欢呼的那 20% 涨幅,已经告诉我们资本选择了哪条路。

问题是,我们选择什么?

在 2026 年,我们必须回答这个问题。

因为留给我们的时间,可能只剩下 24 个月。

来源:微信公众号: 腾讯科技